آزمایشگاه ماشینهای فکری API آموزش Tinker را به ارائه عمومی درآورده و سه قابلیت عمده شامل پشتیبانی از مدل استدلال Kimi K2، نمونهبرداری سازگار با OpenAI، و ورودی تصویر از طریق مدلهای زبانی بینایی Qwen3-VL را اضافه کرده است.

کارکرد واقعی Tinker

Tinker یک API آموزشی است که بر روی تنظیم دقیق مدلهای بزرگ زبانی تمرکز دارد و پیچیدگیهای آموزش توزیعشده را مخفی میکند. شما با استفاده از یک حلقه ساده پایتونی که بر روی یک دستگاه فقط CPU اجرا میشود کار میکنید. داده یا محیط RL، از دست دادن، و منطق آموزشی را تعریف کرده و Tinker این حلقه را روی خوشهای از GPU ها ترسیم و اجرا میکند.

API مجموعه کوچکی از ابتداییها را ارائه میدهد، مانند forward_backward برای محاسبه گرادیان و optim_step برای بهروزرسانی وزنها. این تنظیمات آموزش را برای کسانی که میخواهند بهینهسازی یادگیری نظارتی یا تقویتی را پیادهسازی کنند، ولی نمیخواهند مدیریت خرابیهای GPU و برنامهریزی را انجام دهند، آشکار میکند.

استفاده عمومی و Kimi K2 Thinking

تغییر برجسته در بهروزرسانی دسامبر 2025 این است که Tinker دیگر دارای لیست انتظار نیست. هر کسی میتواند ثبتنام کند، مدلها و قیمتهای فعلی را مشاهده کند و نمونههای راهنما را مستقیماً اجرا کند.

کاربران اکنون میتوانند مدل moonshotai/Kimi-K2-Thinking را روی Tinker تنظیم دقیق کنند. Kimi K2 Thinking مدلی است که برای زنجیرههای طولانی فکر و استفاده سنگین از ابزار طراحی شده است.

نمونهبرداری سازگار با OpenAI

نسخه جدید مسیر دومی را اضافه میکند که رابط تکمیل OpenAI را منعکس میکند. یک نقطه ایستگاه مدل در Tinker میتواند بهوسیله URI ارجاع شود.

ورودی تصویر با Qwen3-VL روی Tinker

قابلیت دوم عمده ورودی تصویر است. Tinker اکنون دو مدل زبانی بینایی Qwen3-VL را ارائه میکند و برای آموزش و نمونهبرداری از همان سطح API در دسترس هستند. برای ارسال یک تصویر به یک مدل، یک ModelInput ایجاد میکند که یک ImageChunk با تکههای متنی به هم پیوسته باشد.

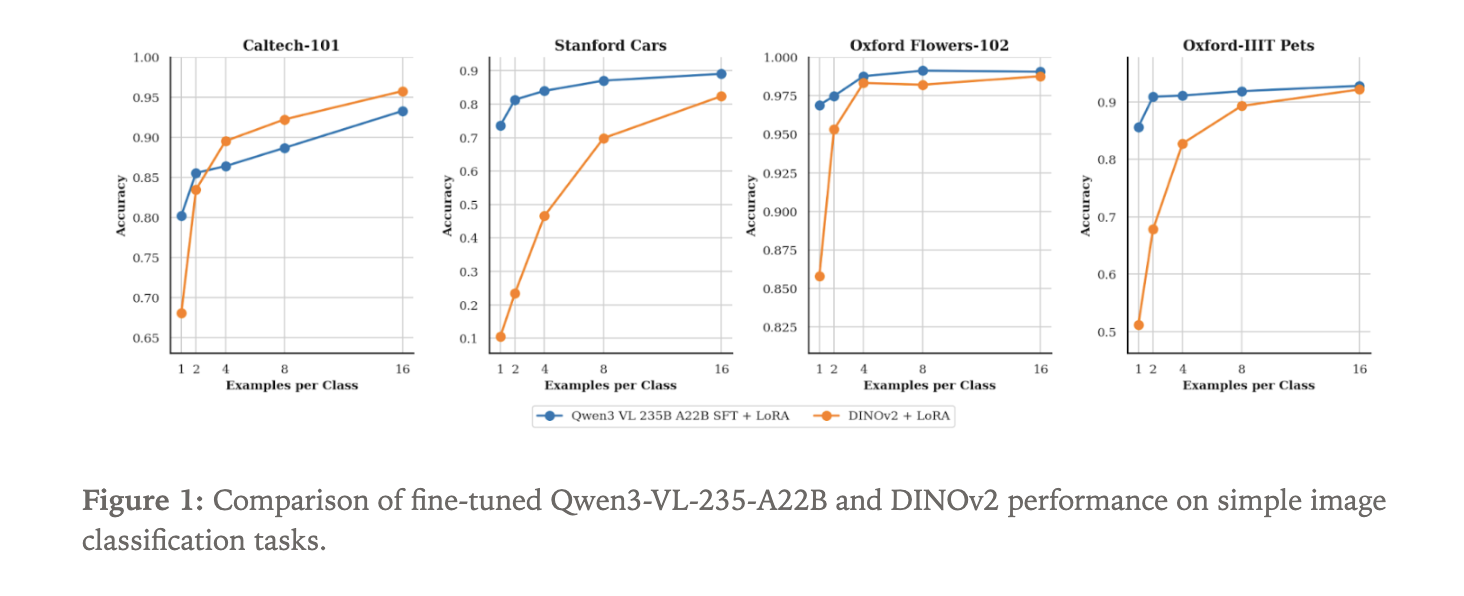

مقایسه Qwen3-VL با DINOv2 در ردهبندی تصاویر

تیم Tinker مدل Qwen3-VL-235B-A22B-Instruct را به عنوان یک دستهبندیکننده تصاویر تنظیم دقیق کرده و از چهار مجموعه داده استاندارد استفاده کردند. Qwen3-VL به عنوان زبانمدلی با ورودی بصری معرفی شده و به عنوان یک توالی متنی، نام کلاس را تولید میکند.

نکات کلیدی

- Tinker اکنون عمومی است و هر کسی میتواند ثبتنام کرده و مدلهای LLM با وزن باز را از طریق حلقه تمرینی پایتونی تنظیم دقیق کند.

- پلتفرم از مدل استدلال Kimi K2 پشتیبانی میکند.

- Tinker رابط نمونهبرداری سازگار با OpenAI را ارائه کرده و امکان ورودی تصویری را از طریق مدلهای Qwen3-VL فراهم کرده است.

- مدلهای Qwen3-VL در تنظیم دقیق قابلیت بهتری در دستهبندی تصاویر در مقایسه با مدل DINOv2 نشان دادهاند.