آزمایشگاه Thinking Machines سرویس آموزشی Tinker را به صورت عمومی عرضه کرده و سه قابلیت جدید شامل مدل تفکر Kimi K2، نمونهگیریهای سازگار با OpenAI، و ورودی تصویری با استفاده از مدلهای زبان تصویری Qwen3-VL اضافه کرده است. این سرویس امکان تنظیم مدلهای پیشرفته بدون نیاز به ایجاد زیرساختهای پیچیده آموزشی را برای مهندسان هوش مصنوعی فراهم میکند.

عملکرد اصلی Tinker

Tinker یک API آموزشی است که بر تنظیم دقیق مدلهای زبانی بزرگ تمرکز دارد و عملیات پیچیده آموزشی را ساده میکند. شما تنها با نوشتن یک حلقه پایتون ساده میتوانید آموزش خود را انجام دهید و این سرویس حلقه شما را بر روی یک خوشه GPU به درستی اجرا میکند.

این API مجموعه کوچکی از عملیات ابتدایی را ارائه میدهد که شامل forward_backward برای محاسبه گرادیانها، optim_step برای بهروزرسانی وزنها، sample برای تولید خروجیها و توابعی برای ذخیره و بارگذاری حالت است. این امکانات به کاربران اجازه میدهد تا آموزش نظارت شده، آموزش تقویت کننده یا بهینه سازی ترجیحی را پیادهسازی کنند.

عمومی شدن و تفکر Kimi K2

تغییر برجسته در بهروزرسانی دسامبر 2025، برداشته شدن لیست انتظار Tinker است. کاربران اکنون میتوانند به راحتی ثبتنام کرده و مدلهای موجود و قیمتها را مشاهده کنند و مثالهای آماده را به صورت مستقیم اجرا کنند.

کاربران اکنون میتوانند مدل moonshotai/Kimi-K2-Thinking را بر روی Tinker تنظیم کنند. این مدل بزرگترین مدل موجود در کاتالوگ Tinker با معماری مبتنی بر ادغام متخصصان است و برای زنجیرههای بلند تفکر و استفاده از ابزارهای سنگین طراحی شده است.

نمونهگیری سازگار با OpenAI در حین آموزش

نسخه جدید یک مسیر دیگر اضافه کرده است که رابط تکمیلی OpenAI را منعکس میکند. یک نقطه بازرسی مدل در Tinker میتواند از طریق URI ارجاع داده شود. این امکان به کاربران ارائه میدهد که با استفاده از استانداردهای OpenAI نمونهگیری کنند.

ورودی تصویری با Qwen3-VL در Tinker

قابلیت دوم مهم ورودی تصویر است. Tinker اکنون دو مدل زبان تصویری Qwen3-VL را ارائه میدهد که برای آموزش و نمونهگیری از همان سطح API در دسترس هستند. شما میتوانید با ساخت یک ModelInput شامل ImageChunk و بخشهای متنی، تصاویر را به مدل ارسال کنید.

رقابت Qwen3-VL با DINOv2 در طبقهبندی تصاویر

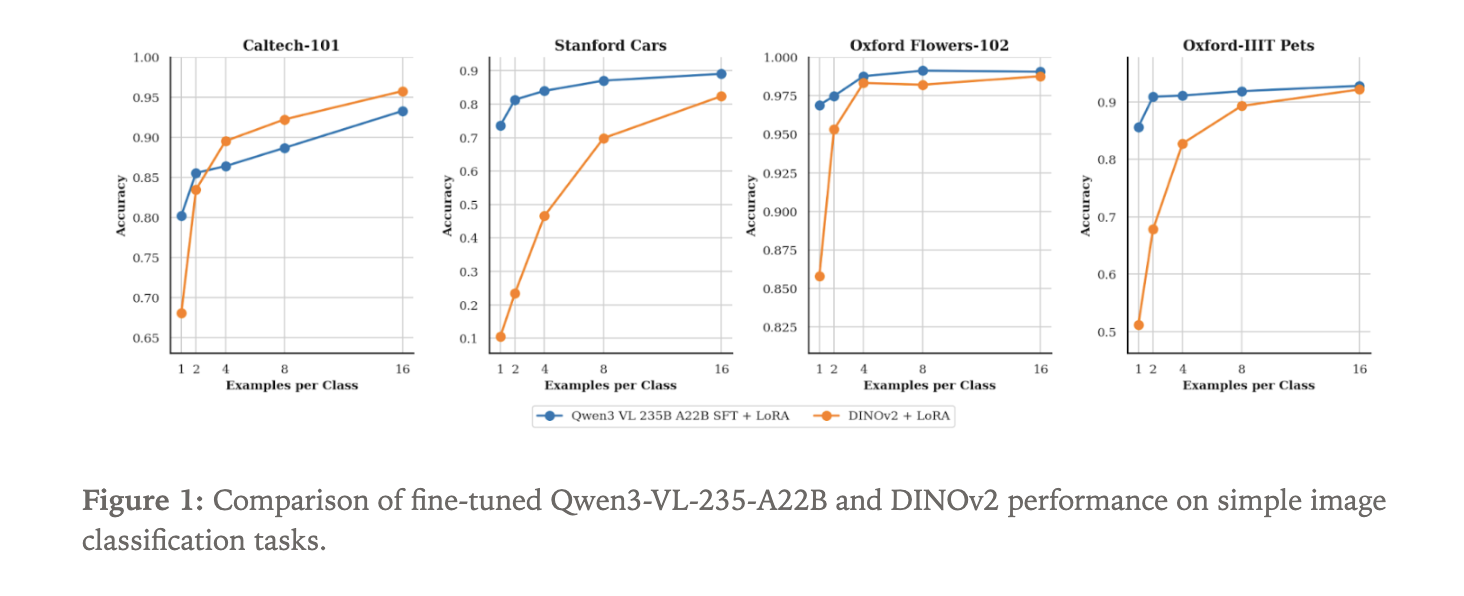

تیم Tinker برای نمایش کارایی مسیر جدید، مدل Qwen3-VL-235B-A22B-Instruct را به عنوان یک طبقهبند تصویر تنظیم کردند و از چهار دیتاست استاندارد استفاده کردند.

- Caltech 101

- Stanford Cars

- Oxford Flowers

- Oxford Pets

مدل Qwen3-VL که یک مدل زبانی با ورودی تصویری است، طبقهبندی را به شکل تولید متن انجام میدهد. تصاویر را دریافت کرده و نام کلاس را به صورت رشته متنی تولید میکند.

نکات کلیدی

- Tinker به صورت عمومی در دسترس است و کاربران میتوانند مدلهای زبانی با وزن آزاد را تنظیم کنند و Tinker بخش آموزش توزیع شده را مدیریت میکند.

- پلتفرم از Kimi K2 Thinking، مدل تفکر با یک تریلیون پارامتر از Moonshot AI پشتیبانی میکند.

- Tinker یک رابط استنتاج سازگار با OpenAI اضافه کرده است که امکان نمونهگیری از مدلها را فراهم میکند.

- ورودی تصویری از طریق مدلهای Qwen3-VL امکانپذیر است و به توسعهدهندگان اجازه میدهد خطوط آموزشی چندرسانهای بسازند.

- تیم Tinker نشان دادند که مدل Qwen3-VL 235B در طبقهبندی چند نمونهای در دیتاستهایی مانند Caltech 101 و Oxford Flowers عملکرد بهتری از DINOv2 دارد.